AULA 15 - Microprocessadores - Graduação: mudanças entre as edições

imported>Fargoud |

imported>Fargoud |

||

| Linha 1: | Linha 1: | ||

=Paralelismo e processamento superescalar= | =Paralelismo e processamento superescalar= | ||

Arquitetura Superescalar | Arquiteturas “Pipelined” com Desempenho | ||

Superior ao de uma Instrução por Ciclo | |||

Arquiteturas Superescalares | |||

• Execução de múltiplas instruções, escalonadas por | |||

“hardware” e/ou “software” | |||

, concorrentemente. | |||

Arquiteturas VLIW (Very Long Instruction Word) | |||

• Execução de múltiplas operações, escalonadas por | |||

“software” | |||

, concorrentemente. | |||

Arquiteturas Multithreading e SMT | |||

• Executam instruções de mais de um fluxo (threads) | |||

simultaneamente. | |||

Arquiteturas Multicore | |||

• Combinação de vários processadores de um mesmo | |||

tipo (acima descrito) em uma única pastilha. | |||

Arquiteturas Superescalares | |||

Organizadas internamente como múltiplos “pipelines” | |||

e com banco de registradores com múltiplas portas de | |||

leitura e de escrita, com múltiplas instruções iniciadas | |||

e terminadas a cada ciclo. O grau de concorrência das | |||

instruções situa-se na prática entre 2 e 4. | |||

As instruções são despachadas para execução | |||

somente quando não violam regras de dependência de | |||

dados, de controle e quando não existem conflitos | |||

estruturais. | |||

• O escalonamento das instruções pode ser feito por | |||

“software” e/ou por “hardware”. | |||

• O código objeto para estas arquiteturas é compatível | |||

com o de arquiteturas escalares convencionais. | |||

Arquiteturas Superescalares | |||

Capacidade para realizar busca e decodificação | |||

de múltiplas instruções por ciclo; | |||

Existência de uma Janela de Instruções que isola | |||

os estágios de busca e decodificação dos estágios | |||

de execução propriamente dita da instrução | |||

modelo de despacho fora-de-ordem: | |||

Janela Centralizada | |||

Estações de Reserva (Algoritmo de | |||

Tomasulo) | |||

Esquemas eficientes de predição dinâmica de | |||

desvios; | |||

Arquiteturas Superescalares | |||

Recuperação do estado da máquina em caso de | |||

exceções ou de previsões erradas de desvios | |||

Reorder Buffer; | |||

Remoção de dependências de dados | |||

Scoreboarding, Tomasulo e/ou Renomeação | |||

Dinâmica; | |||

Lógica de despacho concorrente para as | |||

instruções armazenadas na Janela de I | |||

Arquiteturas Superescalares | |||

Múltiplos barramentos para comunicação de | |||

operandos e resultados e Banco de Registradores com | |||

múltiplas portas de leitura e de escrita, incluindo a | |||

existência de lógica de arbitração se o número de | |||

recursos é menor que o máximo possivelmente | |||

necessário; | |||

Múltiplas unidades funcionais: ALU, Ponto Flutuante, | |||

Desvio, Load/Store; | |||

Suporte para tratamento de dependência de dados | |||

entre instruções de load e store; | |||

A figura a seguir mostra um diagrama de blocos de | |||

um estrutura típica de uma arquitetura superescalar. | |||

Busca e Decodificação | |||

A arquitetura superescalar só é efetiva se a taxa | |||

média com que as instruções são buscadas e | |||

decodificadas for superior à taxa média com que | |||

instruções são executadas. | |||

Esquema eficiente de predição de desvios é | |||

fundamental. | |||

Necessidade de se dispor de um barramento de | |||

acesso ao cache de instruções com largura adequada e | |||

de um decodificador de instruções capaz de decodificar | |||

múltiplas instruções simultaneamente. | |||

Um decodificador de múltiplas instruções demanda a | |||

realização da busca de vários operandos em paralelo | |||

o banco de registradores com múltiplas portas de | |||

leitura. | |||

Degradação do Desempenho da Operação | |||

de Busca de Instruções | |||

Falha no acesso à cache de instruções: | |||

Bem mais do que um ciclo é gasto para a busca do | |||

próximo conjunto de instruções. | |||

Predição errada de desvios: | |||

As instruções buscadas antecipadamente | |||

mostram-se inúteis e novas instruções terão que | |||

ser buscadas. | |||

Alternativa possível: busca simultânea de | |||

instruções de dois ou mais caminhos possíveis do | |||

código a cada desvio condicional aumento no | |||

custo de hardware (cache de instruções com | |||

múltiplas portas de acesso). | |||

Degradação do Desempenho da Operação | |||

de Busca de Instruções | |||

Desalinhamento do endereço das instruções alvo | |||

de um desvio em relação ao início de um bloco de | |||

cache: | |||

Menos instruções úteis são efetivamente buscadas | |||

“slots” de decodificação podem ficar subtilizados | |||

se a unidade de busca não for capaz de realinhar as | |||

instruções antes de passá-las à unidade de | |||

decodificação. | |||

=Arquitetura Superescalar= | |||

Na arquitetura superescalar, várias instruções podem ser iniciadas simultaneamente e executadas independentemente umas das outras. A arquitetura pipeline permite que diversas instruções sejam executadas ao mesmo tempo, desde que estejam em estágios diferentes do pipeline. | Na arquitetura superescalar, várias instruções podem ser iniciadas simultaneamente e executadas independentemente umas das outras. A arquitetura pipeline permite que diversas instruções sejam executadas ao mesmo tempo, desde que estejam em estágios diferentes do pipeline. | ||

Edição das 11h01min de 19 de junho de 2018

Paralelismo e processamento superescalar

Arquiteturas “Pipelined” com Desempenho Superior ao de uma Instrução por Ciclo Arquiteturas Superescalares • Execução de múltiplas instruções, escalonadas por “hardware” e/ou “software” , concorrentemente. Arquiteturas VLIW (Very Long Instruction Word) • Execução de múltiplas operações, escalonadas por “software” , concorrentemente. Arquiteturas Multithreading e SMT • Executam instruções de mais de um fluxo (threads) simultaneamente. Arquiteturas Multicore • Combinação de vários processadores de um mesmo tipo (acima descrito) em uma única pastilha.

Arquiteturas Superescalares

Organizadas internamente como múltiplos “pipelines”

e com banco de registradores com múltiplas portas de

leitura e de escrita, com múltiplas instruções iniciadas

e terminadas a cada ciclo. O grau de concorrência das

instruções situa-se na prática entre 2 e 4.

As instruções são despachadas para execução

somente quando não violam regras de dependência de

dados, de controle e quando não existem conflitos

estruturais.

• O escalonamento das instruções pode ser feito por

“software” e/ou por “hardware”.

• O código objeto para estas arquiteturas é compatível

com o de arquiteturas escalares convencionais.

Arquiteturas Superescalares

Capacidade para realizar busca e decodificação

de múltiplas instruções por ciclo;

Existência de uma Janela de Instruções que isola

os estágios de busca e decodificação dos estágios

de execução propriamente dita da instrução

modelo de despacho fora-de-ordem:

Janela Centralizada

Estações de Reserva (Algoritmo de

Tomasulo)

Esquemas eficientes de predição dinâmica de

desvios;

Arquiteturas Superescalares

Recuperação do estado da máquina em caso de

exceções ou de previsões erradas de desvios

Reorder Buffer;

Remoção de dependências de dados

Scoreboarding, Tomasulo e/ou Renomeação

Dinâmica;

Lógica de despacho concorrente para as

instruções armazenadas na Janela de I

Arquiteturas Superescalares

Múltiplos barramentos para comunicação de

operandos e resultados e Banco de Registradores com

múltiplas portas de leitura e de escrita, incluindo a

existência de lógica de arbitração se o número de

recursos é menor que o máximo possivelmente

necessário;

Múltiplas unidades funcionais: ALU, Ponto Flutuante,

Desvio, Load/Store;

Suporte para tratamento de dependência de dados

entre instruções de load e store;

A figura a seguir mostra um diagrama de blocos de

um estrutura típica de uma arquitetura superescalar.

Busca e Decodificação A arquitetura superescalar só é efetiva se a taxa média com que as instruções são buscadas e decodificadas for superior à taxa média com que instruções são executadas. Esquema eficiente de predição de desvios é fundamental. Necessidade de se dispor de um barramento de acesso ao cache de instruções com largura adequada e de um decodificador de instruções capaz de decodificar múltiplas instruções simultaneamente. Um decodificador de múltiplas instruções demanda a realização da busca de vários operandos em paralelo o banco de registradores com múltiplas portas de leitura. Degradação do Desempenho da Operação de Busca de Instruções Falha no acesso à cache de instruções: Bem mais do que um ciclo é gasto para a busca do próximo conjunto de instruções. Predição errada de desvios: As instruções buscadas antecipadamente mostram-se inúteis e novas instruções terão que ser buscadas. Alternativa possível: busca simultânea de instruções de dois ou mais caminhos possíveis do código a cada desvio condicional aumento no custo de hardware (cache de instruções com múltiplas portas de acesso). Degradação do Desempenho da Operação de Busca de Instruções Desalinhamento do endereço das instruções alvo de um desvio em relação ao início de um bloco de cache: Menos instruções úteis são efetivamente buscadas “slots” de decodificação podem ficar subtilizados se a unidade de busca não for capaz de realinhar as instruções antes de passá-las à unidade de decodificação.

Arquitetura Superescalar

Na arquitetura superescalar, várias instruções podem ser iniciadas simultaneamente e executadas independentemente umas das outras. A arquitetura pipeline permite que diversas instruções sejam executadas ao mesmo tempo, desde que estejam em estágios diferentes do pipeline.

As arquiteturas superescalares incluem todos os aspectos do pipeline e ainda acrescentam o fato de as instruções poderem estar executando no mesmo estágio do pipelining (em linhas pipelining diferentes). Assim, elas têm a habilidade de iniciarem múltiplas instruções no mesmo ciclo de clock. A forma como estão dispostas e utilizadas as estruturas e os componentes do processador define o modelo da arquitetura de um processador. Há diversas classificações de arquiteturas de processadores baseadas nas suas políticas e nos caminhos de execução dos dados.

Uma arquitetura superescalar deve possuir uma série de componentes especiais para executar mais de uma instrução por ciclo:

Unidade de Busca de Instruções: capaz de buscar mais de uma instrução por ciclo. Possui também um preditor de desvios, que deve ter alta taxa de acerto, para poder buscar as instruções sem ter que esperar pelo resultados dos desvios. Unidade de Decodificação: capaz de ler vários operandos do banco de registradores a cada ciclo. Note que cada instrução sendo decodificada pode ler até dois operandos do banco de registradores. Unidades Funcionais Inteiras e de Ponto Flutuante: em número suficiente para executar as diversas instruções buscadas e decodificadas a cada ciclo. Superescalar x superpipeline Uma técnica alternativa para atingir alta performance no processamento é intitulada como superpipelined - termo utilizado pela primeira vez em 1988. Essa técnica explora o fato de que o estágio de pipeline executa tarefas que requerem menos de meio ciclo de clock. Assim, um processador com velocidade de clock interno dobrada, permite um aumento de performance de duas tarefas executadas em um único ciclo de clock externo.

Por exemplo: Uma máquina usando pipeline básico executa uma instrução por ciclo de clock e tem e um estágio de pipeline por clock também. O pipeline tem quatro estágios: busca, decodificação, execução e armazenamento do resultado. Ainda que várias instruções sejam executadas concorrentemente, apenas uma instrução encontra-se na fase de execução.

A implementação superpipelined é capaz de executar duas fases da pipeline de cada vez. Um forma alternativa de observa-lo passa por perceber que as instruções

executadas em cada fase podem ser divididas em duas partes, não sobrepostas, onde cada fase é executada em meio ciclo de clock. Uma implementação superpipelined com este comportamento denomina-se de grau 2. Esta imagem retrata bem as diferenças entre as duas implementações mencionadas.

A implementação superescalar pode executar duas instruções em paralelo, devido ao facto de existirem duas fases homólogas.

Ambas as implementações possuem o mesmo número de instruções executadas ao mesmo tempo, no mesmo estado.

Limitações A abordagem superescalar depende da habilidade de executar várias instruções em paralelo. O termo paralelismo no nível de instruções diz respeito ao nível no qual as instruções de um programa podem ser executadas de forma paralela (em média).

Dependência de dados verdadeira (true data dependency) Considere a seguinte seqüência de instruções:

add r1, r2 # carregar registrador r1 com a soma dos conteúdos de r1 e r2 move r1, r3 # carregar registrador r3 com o conteúdo de r1

A segunda instrução pode ser buscada e decodificada antecipadamente, mas não pode ser executada até que seja completada a execução da primeira instrução. A razão é que ela depende do dado produzido pela primeira. Essa situação é denominada como dependência de dados verdadeira (também chamada de dependência de fluxo ou dependência de escrita-leitura).

Dependência de desvios A presença de desvios condicionais em uma seqüência de instruções complica a operação do pipeline. A instrução seguinte a um desvio condicional (tomado ou não) depende dessa instrução de desvio. Esse tipo de dependência também afeta uma pipeline escalar, mas a conseqüência desse tipo de dependência é mais severa em uma pipeline superescalar, porque o número de instruções perdidas em cada atraso é maior. Se forem usadas instruções de tamanho variável, surge ainda um outro tipo de dependência. Como o tamanho de uma instrução particular não é conhecido, uma instrução deve ser decodificada, pelo menos parcialmente, antes que a instrução seguinte possa ser buscada. Isso impede a busca simultânea de instruções, requerida em uma pipeline superescalar. Essa é uma das razões pelas quais técnicas supersescalares são mais diretamente aplicáveis a arquiteturas RISC ou do tipo RISC, que possuem instruções de tamanho fixo.

Conflito de recursos Um conflito de recurso ocorre quando duas ou mais instruções competem, ao mesmo tempo, por um mesmo recurso. Exemplos de recursos incluem memórias, caches, barramentos, portas de bancos de registradores e unidades funcionais (por exemplo, o somador da ULA). Em termos de pipeline, um conflito de recurso apresenta um comportamento semelhante ao de uma dependência de dados. Existem, entretanto, algumas diferenças. Por um lado, conflitos de recursos podem ser superados pela duplicação de recursos, enquanto uma dependência de dados não pode ser eliminada. Além disso, quando uma operação efetuada em uma dada unidade funcional consome muito tempo para ser completada, é possível minimizar os conflitos de uso dessa unidade por meio de sua implementação como uma pipeline.

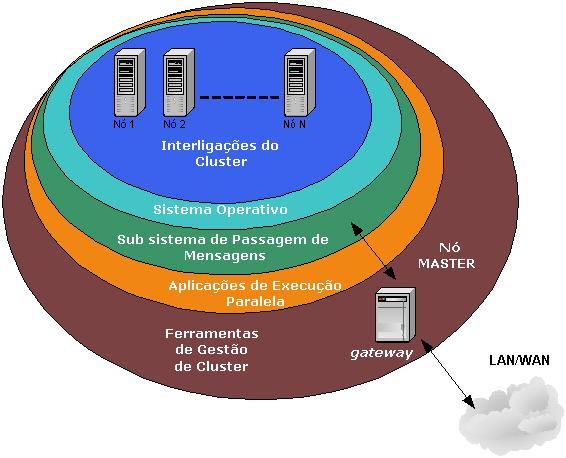

Sistemas paralelos

Um sistema de processamento distribuído ou paralelo é um sistema que interliga vários nós de processamento (computadores individuais, não necessariamente homogêneos), de maneira que um processo de grande consumo seja executado no nó "mais disponível", ou mesmo subdividido por vários nós.

Conseguindo-se, portanto, ganhos óbvios nestas soluções: uma tarefa qualquer, se divisível em várias subtarefas pode ser realizada em paralelo.

A nomenclatura geralmente utilizada neste contexto é HPC (High Performance Computing) e/ou DPC (Distributed/Parallel Computing).